พวกเรามีความยินดีที่จะประกาศว่า งานวิจัย 2 ฉบับจากทีม Typhoon ได้รับการตอบรับให้นำเสนอในงาน EACL 2026

ความสำเร็จนี้นับเป็นอีกก้าวสำคัญที่สะท้อนถึงความมุ่งมั่นของพวกเราในการผลักดันงานวิจัย AI ที่เปิดกว้าง ครอบคลุม และสร้างผลกระทบต่อทั้งประเทศไทยและชุมชน NLP ระดับโลก

โดยงานวิจัยที่ได้รับการตอบรับมีดังนี้:

Main Conference Papers

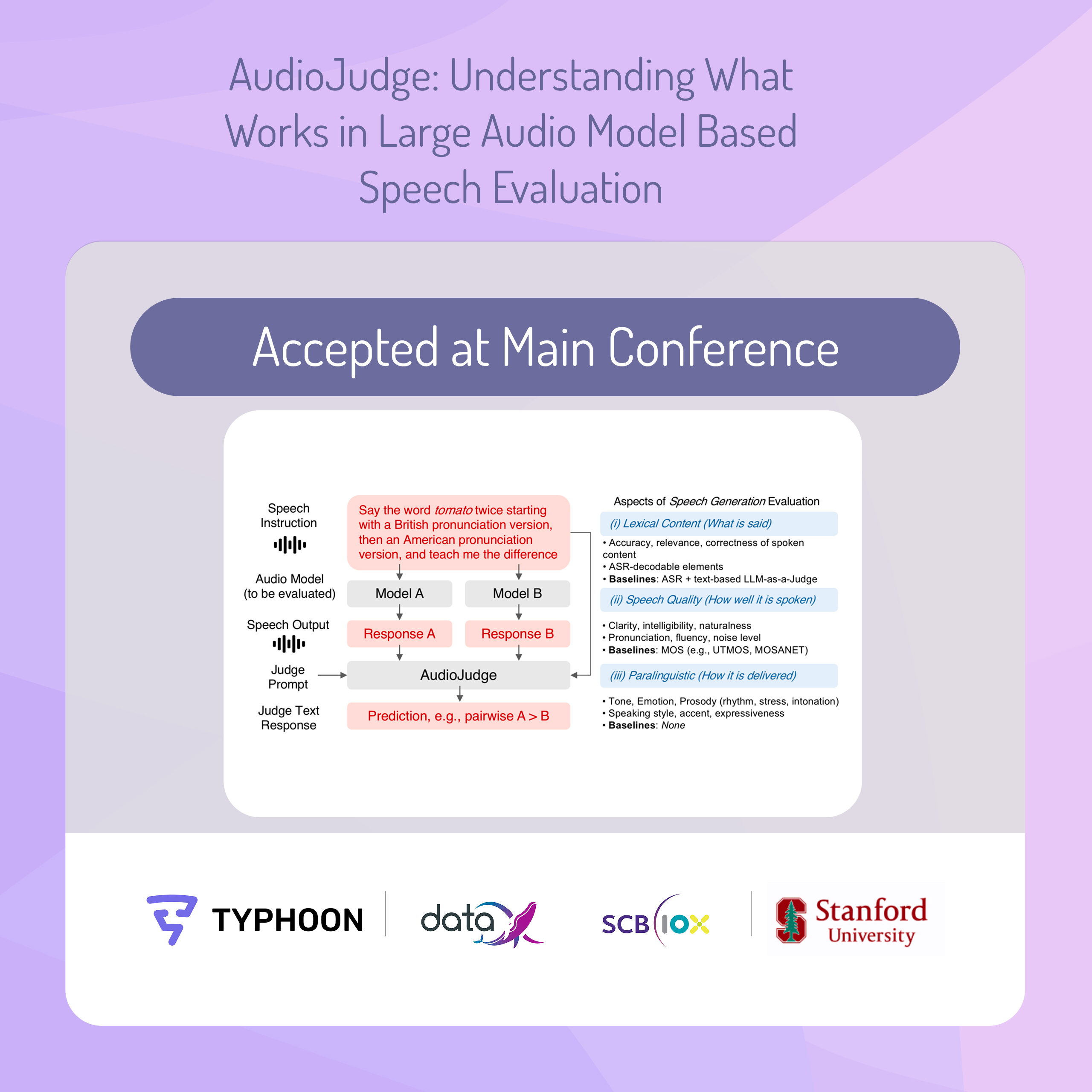

AudioJudge: Understanding What Works in Large Audio Model Based Speech Evaluation

การประเมินคุณภาพเสียง (Speech evaluation) นั้นยังคงเป็นโจทย์ที่ท้าทายด้วยสองเหตุผลหลัก คือหนึ่ง มักต้องพึ่งพา ระบบเฉพาะทางสำหรับคุณลักษณะของเสียงแต่ละด้าน และสอง ตัววัดอัตโนมัติหลายรูปแบบยังมีความสัมพันธ์กับ ความชอบของมนุษย์ (human preferences) ค่อนข้างต่ำ งานวิจัย AudioJudge จึงได้สำรวจความเป็นไปได้ในการใช้ Large Audio Models (LAMs) มาทำหน้าที่เป็น Unified Framework เพื่อประเมินเสียงในหลากหลายมิติพร้อมกัน

แนวคิดหลัก:

- AudioJudge ศึกษาการใช้ Large Audio Models เพื่อทำหน้าที่เป็น 'ผู้ตัดสิน' (Judge) ทั้งในด้าน การตรวจจับคุณลักษณะของเสียง (audio characteristic detection) และ การจำลองความชอบของมนุษย์ในระดับระบบ (system-level human preference simulation) แทนที่จะต้องพึ่งพาเครื่องมือประเมินแยกกันสำหรับแต่ละงาน

วิธีการ:

- ประเมินผลการตัดสินโดยใช้ LAM ในสถานการณ์การประเมินเสียงที่หลากหลาย เช่น การออกเสียง (pronunciation), อัตราเร็วในการพูด (speaking rate), การระบุตัวตนผู้พูด (speaker identification), และ คุณภาพเสียง (speech quality)

- ศึกษาแนวทางการออกแบบ Prompt โดยพบว่าเทคนิค Audio Concatenation ร่วมกับ In-context Learning ช่วยเพิ่มประสิทธิภาพได้อย่างมีนัยสำคัญ

- นำเสนอ Multi-aspect Ensemble AudioJudge ที่แยกการประเมินออกเป็นส่วนย่อยๆ เพื่อตรวจสอบด้านเนื้อหาคำศัพท์ (lexical content), คุณภาพเสียง (speech quality) และคุณลักษณะทางน้ำเสียง (paralinguistic features)

ผลการค้นพบ:

- AudioJudge เป็น Framework อเนกประสงค์ที่แข็งแกร่งสำหรับการประเมินเสียงในหลายด้าน

- ระบบ Multi-aspect Ensemble สามารถทำค่า Spearman Correlation ได้สูงถึง 0.91 เมื่อเทียบกับความชอบของมนุษย์ในเกณฑ์มาตรฐานการจัดอันดับระบบ

- งานวิจัยยังระบุข้อจำกัดสำคัญ เช่น ความเยิ่นเย้อ (verbosity) และ อคติทางตำแหน่ง (positional bias) แม้ว่าความทนทานต่อเสียงรบกวนจะยังอยู่ในเกณฑ์ดีก็ตาม

งานนี้ช่วยให้เราเข้าใจชัดเจนขึ้น ไม่เพียงแค่ว่า Large Audio Models สามารถประเมินเสียงได้ดีหรือไม่ แต่ยังชี้ให้เห็นว่าการออกแบบรูปแบบใดที่จะให้ผลลัพธ์ที่ดีที่สุดในทางปฏิบัติ

Extending Audio Context for Long-Form Understanding in Large Audio-Language Models

Large Audio-Language Models (LALMs) มักถูกจำกัดด้วย Audio Context Window ที่สั้น แม้ว่าตัวโมเดลภาษาที่เป็นแกนหลักจะรองรับบริบทได้ยาวก็ตาม ซึ่งข้อจำกัดนี้ส่งผลกระทบโดยตรงต่อความสามารถในการทำความเข้าใจ เสียงที่มีความยาวมาก (long-form audio) ถึงแม้จะมีวิธีขยาย Context เช่น YaRN สำหรับ LLMs ทั่วไป แต่การนำมาประยุกต์ใช้กับ LALMs นั้นยังไม่มีการสำรวจมากนัก

แนวคิดหลัก:

- งานวิจัยนี้นำเสนอวิธีขยาย Audio Context ใน LALMs โดยไม่ลดทอนความสามารถด้านข้อความของโมเดลเดิม โดยเสนอทั้ง วิธีที่ไม่ต้องเทรนเพิ่ม (Training-free method) และ กลยุทธ์ระหว่างการเทรน (Training-time strategy) เพื่อรองรับอินพุตเสียงที่ยาวขึ้น

วิธีการ:

- นำเสนอ Partial YaRN ซึ่งเป็นวิธีขยายแบบแยกส่วน (Modality-decoupled) ที่ปรับปรุงมาจาก RoPE-based scaling โดยจะแก้ไข เฉพาะตำแหน่งของ Audio Token เท่านั้น ในขณะที่คงตำแหน่งของ Text Token ไว้เหมือนเดิม

- เสนอ Virtual Longform Audio Training (VLAT) ซึ่งนำแนวคิดข้างต้นมาปรับเป็นกลยุทธ์ Positional Augmentation ในระหว่างการเทรน

- จำลองความยาวเสียงที่หลากหลายระหว่างเทรน เพื่อให้โมเดลสามารถทำงานกับอินพุตที่ มีความยาวมากกว่าที่เคยเจอตอนเทรนได้

ผลการค้นพบ:

- Partial YaRN ให้ผลลัพธ์ที่ดีกว่าโมเดลเดิมอย่างสม่ำเสมอในหลากหลายการทดสอบ

- VLAT ช่วยเพิ่มประสิทธิภาพได้อย่างมากเมื่อต้องจัดการกับ อินพุตเสียงที่มีความยาวที่ไม่เคยเจอมาก่อน

- ผลลัพธ์แสดงให้เห็นว่า เทคนิค Long-context จาก LLMs ปกติ สามารถนำมาปรับใช้กับ Audio-Language Models ได้อย่างมีประสิทธิภาพ หากมีการออกแบบที่เหมาะสม

งานวิจัยนี้ช่วยแก้ปัญหาคอขวดสำคัญสำหรับระบบ Audio-Language ในโลกจริง โดยช่วยให้โมเดยก้าวข้ามขีดจำกัดของคลิปเสียงสั้นๆ ไปสู่ความเข้าใจเสียงแบบ Long-form ได้ โดยใช้วิธีที่อาจไม่ต้องเทรนโมเดลใหม่เลย

Looking Ahead

พวกเราภูมิใจที่งานวิจัยเหล่านี้ได้รับการตอบรับใน EACL 2026 ทั้งสองงานนำเสนอทิศทางที่เติมเต็มซึ่งกันและกันในการวิจัยด้าน Audio-Language นั่นคือ การประเมินผลที่ดีขึ้น และความเข้าใจบริบทที่ยาวขึ้น

เมื่อโมเดล Audio-Language เริ่มถูกนำไปใช้งานจริงมากขึ้น ความท้าทายทั้งสองข้อนี้ยิ่งทวีความสำคัญ เราต้องการระบบที่วัดคุณภาพได้ตรงใจมนุษย์ และโมเดลที่ประมวลผลเสียงยาวๆ ได้โดยไม่สะดุด งานวิจัยเหล่านี้คือก้าวสำคัญสู่เป้าหมายทั้งสองประการ

พวกเราตื่นเต้นที่จะสร้างสรรค์งานวิจัย AI ที่เปิดกว้างและใช้งานได้จริงเพื่อชุมชนต่อไป และหวังว่าจะได้นำเรื่องราวดีๆ มาแบ่งปันกันอีกในเร็วๆ นี้